L'office fédéral autrichien des affaires étrangères et de l'asile prévoit l'utilisation de l'intelligence artificielle pour accélérer les procédures d'asile. Sous le nom A.I.SYL, des chatbots devraient à l'avenir fournir des données sur les pays d'origine et des modèles d'IA analyser, catégoriser et résumer automatiquement les informations, rapporte le journal Junge Freiheit. Mais un projet de recherche de Graz met en garde contre des risques considérables.

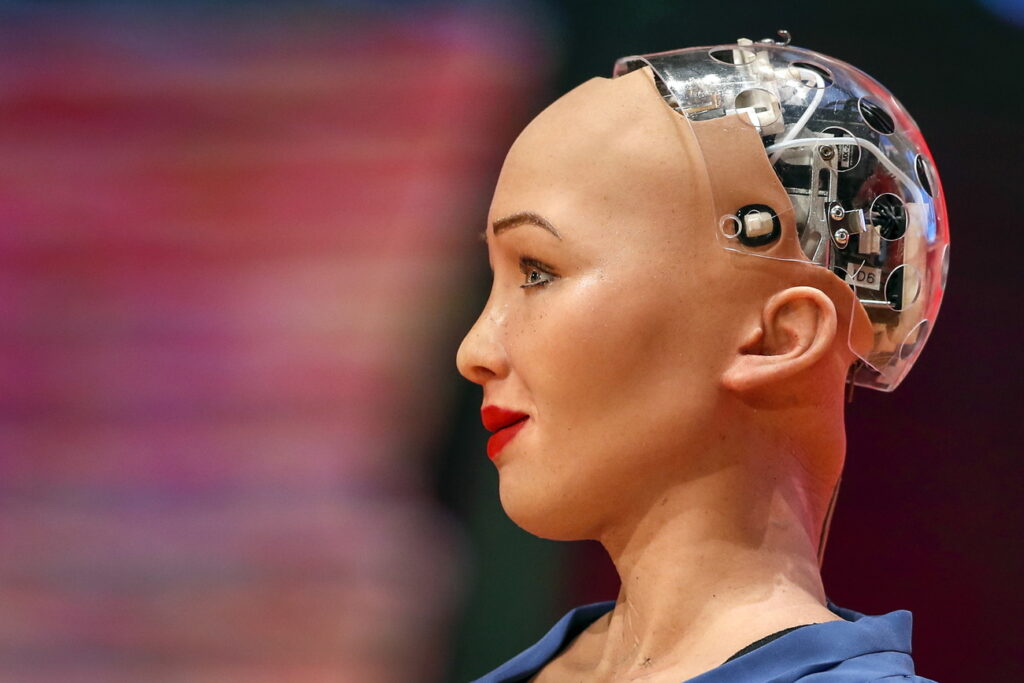

RITCHIE B. TONGO / KEYSTONE

L'université de Graz a étudié les systèmes prévus pendant un an - avec une conclusion sobre. « Aucun des outils testés n'a pu rendre la procédure visiblement plus équitable ou plus conforme à l'État de droit », déclarent les auteurs de l'étude. En revanche, il existe un risque d'une « expérience dangereuse sur le dos des demandeurs de protection ».

La critique se concentre particulièrement sur la documentation nationale dite. Celle-ci fournit des informations de sécurité sur les pays d'origine et devrait à l'avenir être évaluée par IA. Cependant, les soi-disant hallucinations - c'est-à-dire des contenus inventés - et la reproduction de préjugés sociaux pourraient conduire à de mauvaises décisions.

L'évaluation des téléphones mobiles pour déterminer les identités et les itinéraires de voyage est également critiquée. Connectée aux données d'origine et analysée de manière automatique, cela pourrait porter atteinte profondément aux droits fondamentaux des demandeurs d'asile.

Un problème central est en outre le manque de transparence : des modèles d'IA comme les Large Language Models fournissent des résultats dont il est difficile de retracer l'origine - un état de fait intenable pour un processus conforme à l'État de droit, déclare la co-auteure et juriste Angelika Adensamer : « Il faut une base légale claire. »

Mes favoris

Mes favoris Se déconnecter

Se déconnecter